Le pire nom de village français ? « La Mort-aux-Juifs », selon une IA

Une expérience a mal tourné lorsqu'un internaute a demandé à un Macron truqué quels étaient les pires noms de villages français et que l'IA a évoqué le hameau débaptisé en 2015

Pendant plusieurs jours, Emmanuel Macron mais aussi le général de Gaulle et Jacques Chirac ont répondu en direct aux questions des internautes sur la plateforme Twitch. Sauf que leurs voix et leurs mots étaient factices, générés grâce à l’IA par un vidéaste français.

Anis Ayari, ingénieur en intelligence artificielle et créateur de la chaîne YouTube de vulgarisation de l’informatique Defend Intelligence, est à l’origine de ce deepfake (ces hypertrucages de plus en plus réalistes) à visée parodique.

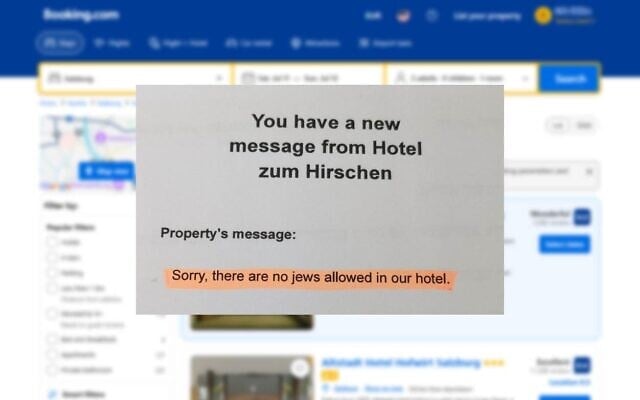

L’expérience a toutefois mal tourné mardi, en fin d’après-midi, lorsqu’un internaute a demandé au Macron truqué quels étaient les pires noms de villages français. L’IA a répondu « La Mort-aux-Juifs« , un hameau du Loiret (centre) débaptisé en 2015, entraînant le bannissement immédiat de la chaîne.

Son créateur a déclaré sur X (ex-Twitter) avoir fait appel de la décision et a relancé le live sur la plateforme concurrente kick.com.

https://twitter.com/DFintelligence/status/1696603099584942363/history

Il y a quelques mois, cet expert, qui commercialise des « agents » virtuels auprès des entreprises, avait déjà fait chanter du Charles Aznavour au chef de l’Etat, tout en dévoilant dans une vidéo les techniques de sa supercherie.

Récemment, il s’est attaqué au clonage de personnages historiques ou à des personnalités comme Elon Musk, qu’il souhaite faire « débattre » avec des acteurs politiques actuels.

« On va simuler un débat politique et regarder où ça nous mène », s’enthousiasme Anis Ayari auprès de l’AFP.

Pour copier la voix d’une personnalité, il suffit de compiler quelques minutes d’un de ses discours, sans bruit parasite. Puis des logiciels s’occupent de créer un modèle de sa voix, permettant de l’utiliser sur de nouveaux contenus, même dans des langues étrangères.

« Avec 15 à 30 secondes de qualité, on commence à avoir des résultats intéressants. Et il n’y a aujourd’hui plus besoin de savoir coder », explique le développeur, qui a lancé un appel aux dons pour financer son live du Président français.

L’utilisation combinée de plusieurs services informatiques lui coûte environ 150 euros par jour, affirme-t-il.

« Parodie »

Mais l’imitation trouve vite ses limites. Le mouvement des lèvres est un peu flou. Et, face aux questions parfois absurdes des internautes, le faux chef d’Etat botte souvent en touche: « La retraite est quelque chose qui échappe à ma programmation. Parlons de sujets plus divertissants », déclare ainsi le Macron truqué.

« Ma déclaration de patrimoine est aussi honnête que la promesse d’un politicien en campagne électorale », lui fait également dire l’IA.

« Il y a vraiment eu un boom l’année dernière sur la génération de voix. Et ça va continuer à s’accélérer », estime Anis Ayari. De nombreux projets permettant à des non-spécialistes de s’essayer aux deepfakes sont développés en Chine, en Corée du sud ou au Japon, où l’imitation de voix de personnages de mangas est très populaire.

Sur la chaîne Twitch TrumpOrBiden2024, des clones du Président américain et de son prédécesseur se sont renvoyé arguments et noms d’oiseaux pendant tout l’été. Leur prise de bec continue, sous le regard de quelques centaines d’internautes qui peuvent lancer des sujets par écrit.

Plusieurs artistes musicaux en ont aussi fait les frais, voyant leur style ou leur timbre de voix copiés sans rien toucher en retour. Les acteurs s’inquiètent, eux, de l’utilisation de leur image par les studios et le monde de la cybersécurité constate la montée en puissance de nouvelles arnaques téléphoniques utilisant le clonage de voix.

Doit-on également craindre une vague de désinformation utilisant ces techniques ? « Plus les gens seront conscients (que les deepfakes existent), plus ils vont exercer leur esprit critique », veut croire Anis Ayari, dont la création porte la mention « parodie ».