Meta reconnaît sa part de responsabilité lors du conflit de mai 2021

L'enquête révèle que l'application excessive des politiques sur Facebook, Instagram et WhatsApp a eu un impact négatif sur la liberté d'expression pendant le conflit

Une enquête commandée par Meta, la société mère de Facebook, Instagram et WhatsApp, a constaté que le contenu incitant à la haine et à la violence contre toutes les parties au conflit de mai 2021, entre Israël et le groupe terroriste du Hamas à Gaza, n’a pas été filtré correctement par les plateformes de réseaux sociaux.

Le rapport d’enquête, publié jeudi, indique que l’application insuffisante des politiques de Meta relatives à l’incitation à la violence et à la haine, ainsi que des politiques relatives aux organisations et aux individus dangereux, a eu pour conséquence que ces contenus sont restés en ligne et que les comptes incriminés sont restés impunis.

Le document a également révélé que l’application excessive de ses politiques, c’est-à-dire la suppression injustifiée de contenu, constituait également un problème et avait un impact négatif sur la liberté d’expression, la liberté de réunion et d’association, la liberté d’incitation et la sécurité physique de ses utilisateurs.

L’enquête commandée par Meta pour évaluer l’impact de ses plateformes pendant le conflit de mai 2021, affirme que le contenu en langue arabe a souffert d’une application excessive et insuffisante dans une plus large mesure que le contenu en hébreu.

Le rapport a donc conclu que les mesures d’application de la politique de Meta avaient eu un effet particulièrement négatif sur la liberté d’expression, la liberté de réunion et la participation politique des utilisateurs palestiniens.

Cela a limité la capacité des Palestiniens à partager des informations et leurs points de vue sur leurs expériences durant le conflit, a indiqué le rapport.

Dans le même temps, le rapport affirme que Meta, en raison d’une application insuffisante de ses propres politiques, n’a pas supprimé les contenus en langue arabe qui incitaient à la violence contre les Israéliens et faisaient l’éloge de l’organisation terroriste du Hamas.

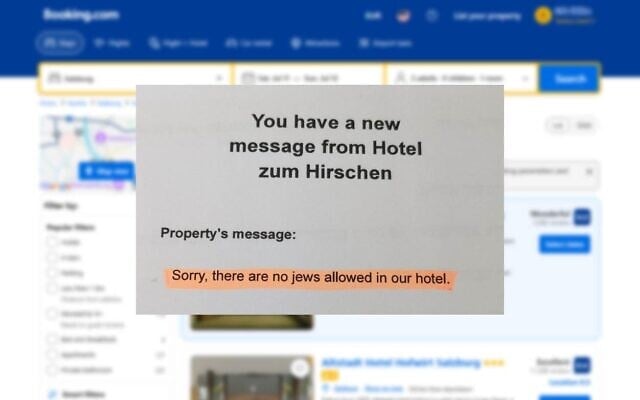

Il note également que des contenus antisémites sont restés en ligne, malgré la violation des politiques de Meta en matière de discours de haine.

De manière plus générale, le rapport note que les plateformes de Meta ont toutes été utilisées pour diffuser « des discours de haine et d’incitation à la violence contre les Palestiniens, les Arabes israéliens, les Juifs israéliens et les communautés juives en dehors de la région » tout au long du conflit.

Le rapport attribue le fait qu’une partie de ces contenus n’ait pas été supprimée au volume élevé de commentaires pendant le conflit et au manque de personnel parlant arabe et hébreu capable de surveiller et traiter le pic de manière adéquate.

Le rapport n’a pas examiné si ce type de contenu avait eu des conséquences dans le monde réel.

Mercredi, le chef de la police israélienne, Kobi Shabtai, a déclaré que les contenus diffusés sur les plateformes de réseaux sociaux avaient « poussé les civils dans les rues » pour participer aux émeutes en Israël, tant par des Israéliens arabes que juifs.

Shabtai a affirmé que le préjudice réel de ce type de contenu posté sur les réseaux sociaux justifiait une fermeture pour une durée limitée de ces réseaux afin de calmer les futures situations de graves troubles civils.

Le rapport publié jeudi a été commandé par Meta en juillet de cette année, à la suite d’une recommandation de son conseil de surveillance lui demandant de faire preuve de diligence raisonnable quant à son impact sur les droits de l’homme – en l’occurrence dans le conflit israélo-palestinien et, plus largement, dans les différents conflits mondiaux.

Il s’agit de la neuvième enquête de ce type – sur les conséquences du contenu des plateformes de réseaux sociaux de Meta. Des enquêtes similaires concernaient l’impact de Facebook sur le génocide des musulmans rohingyas au Myanmar, ainsi que l’effet des plateformes de Meta sur les violations des droits de l’homme aux Philippines, au Cambodge, en Indonésie et au Sri Lanka, entre autres.

Bien que le document ait fait des affirmations et des recommandations générales sur l’impact des politiques d’application de Meta, il n’a cité presque aucun exemple concret d’application excessive ou insuffisante des politiques de Meta, ce qui rend difficile l’évaluation des résultats.

Le cas, qui a conduit à la commande de l’enquête, a toutefois été divulgué.

Un utilisateur de Facebook en Égypte a partagé en mai 2021 une publication provenant d’une page vérifiée d’Al Jazeera, qui comprenait des citations attribuées à un porte-parole de la milice terroriste paramilitaire des Brigades Al-Qassam du Hamas.

Le porte-parole a fait des commentaires exigeant qu’Israël mène certaines actions à Jérusalem et l’ont averti des conséquences s’il ne s’exécutait pas.

La publication a été retirée pour avoir enfreint la politique de Meta sur les « Individus et Organismes Dangereux » (DIO), qui interdit d’exprimer des louanges ou un soutien à de telles entités et personnes, ou de créer du contenu qui les représente, tel que des pages ou des événements Facebook.

En appel, l’utilisateur a insisté sur le fait qu’il avait partagé le message pour informer les gens de l’évolution de la crise et qu’il ne faisait que partager le message d’Al Jazeera, qui n’avait pas été supprimé.

Après avoir examiné le cas, Facebook a estimé que la suppression de la publication était un cas d’application excessive de la loi et a rétabli le contenu.

Un autre exemple clé d’application excessive de la loi dans les messages en langue arabe cité dans le rapport, est l’ajout du hashtag #AlAqsa à une liste de blocage de hashtags en raison de la similitude de ce terme avec les Brigade des martyrs d’Al-Aqsa, un groupe terroriste interdit par la politique de Meta en matière de DIO.

Le hashtag #AlAqsa a donc été masqué des résultats de recherche bien qu’il soit utilisé par les utilisateurs de Meta pour discuter de la mosquée Al-Aqsa à Jérusalem, l’un des sites les plus sacrés de l’islam et un point central du conflit de mai 2021.

Selon le rapport, le contenu en arabe a fait l’objet d’une application excessive plus importante – c’est-à-dire la suppression par erreur de contenu exprimant la « voix palestinienne » – que le contenu en hébreu.

Dans le même temps, les « taux de détection proactive » en arabe étaient également plus élevés, probablement en raison de l’obligation légale de Meta de supprimer le contenu lié aux organisations terroristes étrangères désignées par les États-Unis, notamment le Hamas et d’autres milices terroristes palestiniennes.

De même, le rapport a constaté que les Palestiniens étaient plus susceptibles de violer la politique de Meta en matière de DIO puisque le Hamas, l’un de ces groupes désignés, dirige Gaza.

Étant donné que les violations en matière de DIO entraînent de lourdes pénalités pour les utilisateurs, les Palestiniens étaient plus susceptibles de subir des conséquences plus sévères « pour une application correcte ou incorrecte de la politique ».

Le rapport d’enquête a également constaté des cas de sous-application de la politique sur les contenus en hébreu et en arabe, ce qui signifie que certains messages incitant à la violence n’ont pas été supprimés.

Mais la sous-application était plus fréquente pour les contenus en hébreu, ce qui signifie que l’incitation à la violence et d’autres contenus à l’encontre des Palestiniens et des Arabes israéliens étaient moins souvent supprimés et que les utilisateurs publiant de tels contenus étaient moins souvent soumis à des mesures disciplinaires.

Cela était dû en grande partie au fait que Meta ne disposait pas à l’époque d’un « classificateur » en hébreu, un algorithme qui identifie et trie le contenu, y compris les messages qui ont une forte probabilité de violer les politiques de Meta, a indiqué le rapport.

Meta a déclaré qu’elle avait désormais créé un classificateur en hébreu pour résoudre ce problème.

Un autre problème mentionné dans le rapport est le taux d’erreur plus élevé dans les classificateurs arabes pour le dialecte arabe-palestinien, et l’incapacité d’envoyer le contenu, soumis à examen, au personnel qui comprend ce dialecte.

Le rapport indique également que le volume de dossiers concernant des contenus susceptibles d’enfreindre les normes de Meta a augmenté de façon spectaculaire, jusqu’à dix fois le volume normal, ce qui ont rendu l’examen et l’application plus difficiles.

L’une des principales conséquences de l’application excessive des règles pendant le conflit de mai 2021 a été la perte de visibilité et d’engagement des utilisateurs après que des messages ont été supprimés par erreur, affirme le rapport.

Le rapport a noté que Meta ne faisait pas de distinction entre les différents types de discours à caractère haineux, mais reconnaît que les organisations qui surveillent l’antisémitisme « ont suivi des contenus clairement antisémites qui violaient les politiques de Meta et qui n’ont pas été détectés et supprimés pendant cette période », citant des études du Congrès juif mondial et du Community Security Trust du Royaume-Uni.

Il a déclaré que cela était le résultat d’une « compétence culturelle insuffisante de la part des modérateurs de contenu » et d’une « capacité linguistique insuffisante » de la part de ceux qui définissent la politique pour les langues dans lesquelles le contenu antisémite apparaît.

Le rapport fait également état de cas où WhatsApp a été utilisé par des Israéliens d’extrême-droite pour inciter à la violence et coordonner des attaques contre des Israéliens arabes et juifs, ainsi que contre des journalistes israéliens.

Il affirme que malgré les erreurs de modération de contenu sur les plateformes de Meta, il n’y avait pas de « partialité intentionnelle » au sein de l’entreprise, ni « de preuve d’animosité raciale, ethnique, nationale ou religieuse dans les équipes dirigeantes ou de preuve que Meta avait intentionnellement cherché à bénéficier ou à nuire à un groupe particulier en raison de sa race, de sa religion, de sa nationalité, de son ethnicité ou de toute autre caractéristique protégée lors de l’élaboration ou de la mise en œuvre des politiques ».

L’enquête, réalisée par le groupe de consultants BSR, a formulé une série de recommandations pour résoudre les problèmes, que Meta a déclaré être en train de mettre en œuvre, de mettre partiellement en œuvre ou d’évaluer la viabilité de la mise en œuvre.

« Il n’y a pas de solution rapide, applicable du jour au lendemain, pour nombre de ces recommandations », a déclaré Meta en réponse au rapport d’enquête.

« Bien que nous ayons déjà apporté des changements importants, ce processus prendra du temps, du temps également pour comprendre comment certaines de ces recommandations peuvent être traitées au mieux, et si elles sont techniquement réalisables. »

ÉDITION LIMITÉE : Rejoignez la communauté du Times of Israël pour seulement 6 euros par mois et recevez un sac fourre-tout exclusif Times of Israël orné d’un oiseau emblématique d’Israël.

Choisissez entre le Doukhifat (huppe, orange), oiseau national d’Israël, et le Shaldag (martin-pêcheur, bleu), symbole emblématique de la faune israélienne.

En vous abonnant aujourd’hui, vous profiterez d’une lecture sans publicité, ainsi que d’un accès à des contenus en avant-première, incluant éditos, reportages et interviews.